深度學習以大數據為基礎,借鏡了人類的大腦,透過精巧的演算法設計、有效率的最佳解搜尋,讓以前看似不可能的複雜運算與機器識別都能實現。

接下來,本專欄將介紹深度學習的各種應用,讓讀者掌握這項技術的思路精髓。

也不過才約一年前,2016年3月,AlphaGo以橫空出世的姿態,以4:1擊敗圍棋冠軍,雖然並未全勝,不過一直以來被視為人類思維的最終堡壘圍棋仍舊是被擊潰了。從那之後,包括2016年10月微軟將語音識別的錯誤率降至5.9%,優於人類專業速記員水準;2016年11月谷歌也更換了深度學習版的機器翻譯,也強調已能接近人類翻譯的水準(或許中文仍例外⋯)。一直到2017年1月,AlphaGo再度以Master姿態,一路狂宰柯潔、戰勝聶衛平而取得59勝的佳績;沒隔多久,美國卡內基梅隆大學的Libratus也在德州撲克項目獲得大幅度優勝。

這一堆眼花撩亂的戰績,也有不以為然的人表示人工智慧都說了好幾十年了,哪一次成真過?這句話說得倒也不是沒有道理,不知道大眾是否還能記得人腦第一次輸給電腦是哪一年?大家可能都還記得那台電腦的名字叫做深藍,以及當時西洋棋王卡斯巴羅夫懊惱的神情,但是年份可能記不得了,答案是1997年,也就是距今20年前。

那為何當時沒有現在的恐慌?這道理很簡單,因為那時的電腦是利用暴力解題法的方式來擊倒人類的,對於萬物之靈的人類來說,在大自然比我們有力氣的、跑得快的、飛的高的事物多的是,只要不會思考就一律稱之為「工具」,既然是工具就是為我們所用,自然沒有什麼好懼怕的。

人工智慧歷經數度興衰

但說實話,在過去的歷史中,的確人工智慧喊著「狼來了」好多次,從1950年,圖靈預言了能夠創造有思考能力的電腦的可能,1956年(去年剛好是達特茅斯會議60周年)的達特茅斯會議(圖1)正式定下了人工智慧這個名詞以來,總共歷經了兩次低潮期,而這兩次都剛好與機器學習中的連結主義派(也就是類神經網路)的發展與限制有關。

|

| 圖1 2006年達特茅斯會議後50周年,當年主要參與者舊地重聚。 |

第一次興起是達特茅斯會議後,但是1974年進入了低潮期,原因是類神經網路跟當時的計算力太不成比例,因此發展陷入瓶頸。然後1982年Hopfield神經網路以及反向傳播法(今日深度學習的重要基礎)的發明讓大家重新燃起希望,但是商業界過度追捧,以及個人電腦的性能快速成長讓這些一開始看似高科技的產品淪為庫存,因此5年後人工智慧又再度進入了寒冬。

所以大家這次對於人工智慧充滿懷疑是再正常不過的反應,不過雖然離「具有自我意識」的強人工智慧還非常遠,但是這次至少是不致於過度泡沫化的(科技的部分筆者還敢保證,但是過度商業炒作這塊則持保留態度),這是因為這次的人工智慧浪潮也伴隨著一波類神經網路技術的興起,那就是「深度學習(Deep Learning)」。

深度學習開啟人工智慧之門

筆者常開玩笑說,如果未來真的人工智慧會讓許多人失業,而且未來真的有時光機的話,那如同魔鬼終結者類似的劇情,那些失業的人要回到過去找一人算帳,那就應該是找Hinton(圖2)沒錯了。在人工智慧長達20年的寒冬,中間即使是有深藍贏得西洋棋王的事件,仍然沒有絲毫興起的態勢,因為大家變得更為嚴格了,若只是用暴力解題法,是沒辦法被認可為人工智慧的。

|

| 圖2 深度學習之父Geoffrey Hinton |

而在這嚴峻的寒冬中,Hinton仍舊不放棄對於神經網路的熱愛,甚至他為了避開當時學術期刊幾乎封殺神經網路的態度,故意將神經網路改個名字為「深度學習」,各位就知道他對深度學習宗教般的使命感。於是在2006年,他的一篇論文:「A Fast Learning Algorithm for Deep Belief Nets」,在這篇文章他提出了深度信念網路,為神經網路只能靠隨機分配權重的觀念重寫,讓難以訓練的標籤終於被摘下,而引發了後續一連串的研究與奇蹟。

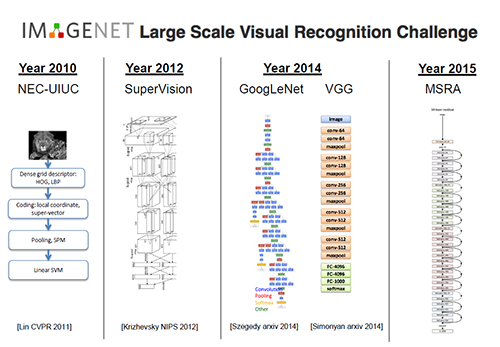

而深度學習一開始只是學術圈的小眾研究,為了證明深度學習的泛用性,Hinton與他的學生團隊於2012年參加了全球性的機器視覺大賽Imagenet(圖3),他所使用的正是他好友同時也是被人稱為深度學習三大神之一的Yann LeCun所發明的卷積神經網路(Convolutional Network),結果將連續數年未能降低的Top5錯誤率從26.2%一路下降到15.3%。這才讓世人重新了解了這個技術的潛力,而如今Imagenet排行榜上已經沒有任何團隊不是使用卷積神經網路,而從2012年起,每年的Imagenet紀錄都一路被打破,一直到2015年,微軟將錯誤率一舉下降到4.94%,終於打破了人類錯誤率(5.1%)的壁壘。

|

| 圖3 歷年來機器視覺大賽Imagenet冠軍團隊採用的技術 |

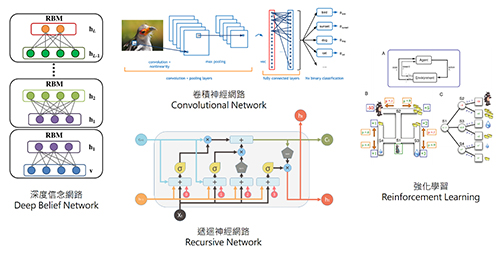

從Imagenet的成功,讓整個深度學習百花齊放,各種舊有的理論都隨著Hinton的研究成果又獲得新生,除了Hinton的開山作深度信念網路、以人類視覺為基礎的卷積神經網路、以序列以及記憶為基礎的遞迴神經網路,現在還有了以「巴法洛夫的狗」這種傳統制約理論為基礎的強化學習,這些都成為現在深度學習的重要典範。

對抗式生成模型技術

接下來,筆者每個月都會有專欄文章來介紹深度學習的各種神奇的應用(圖4),也會盡量以不需要太多數學背景的敘述方式,讓讀者不會有負擔,同時掌握這項技術的思路精髓。這次從過去的歷史來看人工智慧的過去,下個月我們將會直接跳到最前瞻的深度學習:對抗式生成模型(Generative Adversarial Networks, GAN),對抗生成模型可以說是最有魔性的深度學習技術,透過仿造來驗證學習成果,各位可以期待一下。

|

| 圖4 各種不同的深度學習技術與應用 |

最後,如果要對深度學習下一個註解,筆者覺得深度學習最顛覆的觀點在於過去我們總是習慣馭繁為簡,但是深度學習站在大數據的基礎上,開始正面對決維度的複雜度。而許多人類看似複雜的問題,站在高維的角度看來反而變得簡單清晰,而深度學習借鏡了人類的大腦,透過精巧的演算法設計、有效率的最佳解搜尋,讓這些以前看似不可能的都能透過深度學習實現。

但是有一點是要記得的,目前的技術仍舊無法賦予電腦思考的能力,即使強如AlphaGo,它們也只是學會了如何計算下棋的最佳方法,而非是學會了思考,所以身為人類的我們,未來所需要面對更重要的課題反而是該如何借用人工智慧的力量來協助自己從繁瑣無聊的事物中解放出來,讓人類可以運用大腦來做更有意義的事。