語音辨識不算新玩意,但在自然語言處理技術及人工智慧的加持下,現在的語音助理不僅能控制家中的各式設備,還可以連上雲端,與各種資訊服務結合。語音助理很可能會成為繼遙控器、觸控螢幕之後,最重大的人機介面創新,相關軟硬體業者無不為此全力備戰。

將各式各樣的智慧應用服務帶入家庭,可說是科技產業追逐已久的大夢,但要如何讓使用者與機器設備自然地互動,卻是人因工程上的大挑戰。就人類的角度,最終極的人機介面應該是用意念來對機器下達指令,但目前相關技術還在基礎研究階段,短期內很難看到商品化的機會;動口不動手,用自然語言來傳達指令,則是次佳的解答。但這項功能在硬體和軟體方面,都有很大的技術挑戰。

語音辨識添智慧 亞馬遜/Google兩強相爭

在硬體面,收音系統的設計涉及許多聲學上的專業及複雜的演算法,例如指向性收音、回音消除、背景噪音消除等。而在軟體面,系統除了要聽得懂各種自然語言外,還得考慮各地方腔調、習慣用語等變數,才能提供精準的辨識結果,並進一步將其中的關鍵字萃取出來,轉化成系統能理解的指令。

在語音辨識與人工智慧結合之後,利用語音指令操作硬體設備出現重大突破。亞馬遜(Amazon)在2014年底正式推出Echo聲控揚聲器(圖1),並可透過其內建的Alexa語音助理,為使用者提供查詢天氣、訂購商品、控制家中其他電器設備等種種應用服務。

|

| 圖1 亞馬遜Echo智慧揚聲器 |

Echo揚聲器推出後,不僅引發話題,更在消費市場上獲得歡迎。據研究機構Consumer Intelligence Research Partners預估,自2014年底上市以來,Echo揚聲器在美國已賣出超過510萬台。由於Echo揚聲器並非個人消費性電子產品,其銷售型態比較接近一戶一台,因此510萬台這個數字已相當可觀。

就在Echo揚聲器取得重大成功之後,同樣在人工智慧領域有深入布局的Google,在2016年底發表Google Home,該產品同樣是搭載語音助理及人工智慧的揚聲器,與Echo在本質上並無太大差異。不過,由於Google本身已經有相當多樣化的雲端服務,因此Google Home所搭載的Google Assistant語音助理,未來很可能會與自家的其他服務進一步結合,以便滿足消費者各式各樣的需求。

但亞馬遜也不是省油的燈。或許是早已預料到其他大廠也將加入智慧揚聲器戰局,該公司早在Echo推出後半年,便宣布將開放Alexa服務給其他開發商使用,同時還提供相關硬體開發套件給其他業者,要藉由生態系的力量來拉開與其他競爭平台的差距。截至目前為止,Alexa已經有超過七千項技能(Skill,類似智慧型手機上的App)可供使用者下載,涵蓋領域包含天氣預報、新聞、家庭自動化控制、教育、運動健身等(圖2)。

|

| 圖2 Echo揚聲器所搭載的Alexa語音助理,已經成為一個龐大的生態系統。 |

精準接收語音指令 麥克風陣列技術不可或缺

智慧揚聲器的使用者體驗好壞,主要涉及四大環節,分別是收音麥克風、語音處理器、語音辨識引擎以及雲端上各種應用服務。其中,收音麥克風的設計,是智慧揚聲器能否精準辨識使用者指令的第一道關卡。

泉聲電子董事長溫增豐表示,利用語音指令來控制電子產品,對使用者來說,是最自然的人機介面。但要讓機器設備清楚地聽到指令,背後涉及許多聲學上的專業。

在家庭環境中,其實存在著許多背景噪音,麥克風本身也有底噪。要避免這些噪音蓋過使用者所發出的語音指令,可分成兩個層次來談。針對外部的背景噪音,硬體製造商可透過多顆麥克風元件搭配噪聲消除演算法,來消除使用者以外的雜音。這部分涉及麥克風製造商及語音處理器的搭配。至於麥克風的底噪,則要看電聲元件業者的功力,以及所選用的麥克風設計架構。

一般來說,駐極體麥克風(ECM)的訊噪比(SNR)是最好的,可達70dB以上。截至目前為止,專業錄音室所使用的麥克風,基本上都還是ECM的天下。不過,微機電(MEMS)麥克風的訊噪比近年來也有顯著改善,目前業界的水準可以做到64∼65dB,與ECM的差距正在拉近。

不過,ECM有一個先天的缺點,就是採用陣列式設計時,ECM麥克風模組的組裝加工較為困難,MEMS則沒有這個問題,在大量生產時,加工相對簡便。不過,MEMS麥克風先天上對低頻的反應不如ECM麥克風,這也是應用開發商在選擇麥克風元件時,必須特別注意的。

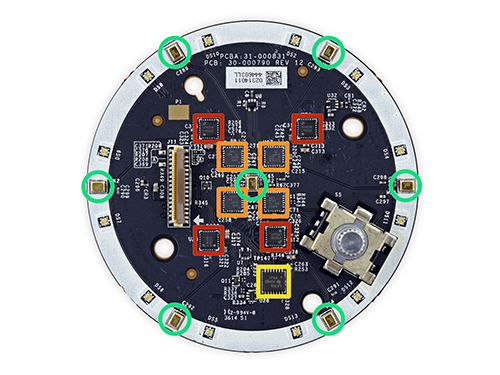

因此,溫增豐總結指出,就智慧揚聲器應用來說,未來應該會是以MEMS麥克風為主流。畢竟,在採用陣列式架構的前提下,MEMS麥克風有很明顯的優勢。目前市面上的智慧揚聲器,絕大多數都是採用陣列式麥克風,例如中國科大訊飛和電商平台京東聯合成立的靈隆科技,便推出了採用五顆麥克風的叮咚音箱;亞馬遜的Echo則內建七顆麥克風(圖3);Google Home則只有兩顆。

|

| 圖3 Echo揚聲器頂端的周圍與正中央,一共內建了七顆MEMS麥克風。 |

雖然麥克風的數量不一定能跟語音指令的接收效果畫上等號,但麥克風數量越多,理論上音源追蹤的解析度也越高,亦即更能精準鎖定發話者的相對角度,並濾除掉其他背景雜訊。

值得一提的是,麥克風收音效果的好壞,除了跟麥克風元件有關之外,應用產品的機構設計也會對收音效果產生決定性影響。因此,硬體製造商若不是自己的機構團隊有一定的聲學設計實力,就要靠電聲元件供應商提供支援。而這也是電聲元件廠的考驗之一。

語音處理器商機湧現 土洋IC廠大對決

在麥克風接收到聲音訊號後,後續的噪音消除、回聲消除、音源追蹤、背景音消除等功能,原則上都是透過語音處理器搭配各種專用演算法來實現,有些則可以透過更後段的語音辨識引擎來處理。不管是微處理器(MPU)或數位訊號處理器(DSP),都可以扮演語音處理器的角色。

目前市場上最主要的語音處理器供應商,除了與亞馬遜結盟的科勝訊(Connexant)之外,台灣本土IC設計業者驊訊、瑞昱、新唐也都有晶片解決方案。樓氏電子(Knowles)則為了強化其麥克風業務布局的完整性,購併了語音處理技術業者Audience。據了解,聯發科內部也有一支研究團隊正在研究相關題目,更有意要打進亞馬遜供應鏈。

事實上,語音處理器已經是相當成熟的技術,加上半導體效能飛快成長,就硬體的層面來說,針對一般應用,目前市面上有很多平價Cortex-M微控制器(MCU)或入門級DSP,都已經能扮演語音處理器的角色,差別僅在於各家廠商所開發的獨特演算法,可能在不同的特定情境有特殊優勢;又或是某些針對高階語音設備,例如遠距會議設備所設計的專用晶片,以便執行一些非常複雜而特別的演算法。

人機溝通情況特殊 辨識引擎調校不可免

不過,由於語音辨識技術是最近幾年才突然竄起的新領域,現有的語音處理器大多仍是為了人與人的語音通話需求而設計,因此語音訊號處理器輸出資料到語音辨識引擎後,還是有很多匹配跟調校的工作要做。

賽微科技副總經理劉進榮(圖4)便指出,人的聽覺是個很有趣的感官,很多語音處理器輸出的訊號其實仍含有很多雜訊,但在人的耳朵聽起來,卻已經非常清晰。然而,這些訊號進入語音辨識引擎後,由於雜訊還是很明顯,會影響辨識準確率,因此辨識引擎仍須對訊號再做一次清理,才會開始進行語音辨識。辨識引擎業者必須視應用的實際狀況進行程度不一的客製化,語音處理器跟語音辨識引擎才能完美匹配。

|

| 圖4 賽微科技副總經理劉進榮指出,語音辨識引擎不一定非得要靠雲端資源才能實現。 |

相較於手機或PC上的語音助理,Echo這類智慧揚聲器的語音辨識系統設計是非常複雜的。手機或PC的語音助理是近場收音,情況單純很多,但智慧揚聲器或其他支援語音控制的智慧家電,則是遠場收音系統,因此從麥克風、語音處理器到語音辨識引擎,整個訊號鏈在設計時都要考慮到更多變數。

至於語音辨識引擎本身,近幾年來在技術上也有相當明顯的突破。早期的語音控制系統其實並不好用,使用者必須記住很多指令,而且要一字不差地唸出那些指令,系統才會回應。不過,隨著自然語言處理技術(Naturl Language Processing, NPL)取得重大進展,讓使用者不用再背誦指令,可以用很自然、口語的方式表達其意圖,辨識引擎則從中提取出幾個關鍵字,經過演算、重組後精確判斷使用者意圖,並執行相應的指令。

本地端/雲端辨識引擎各有長處

在本屆CES上,搭配雲端辨識引擎的智慧揚聲器雖然大出風頭,但劉進榮認為,在智慧家庭應用中,產品開發商不一定要一窩蜂地加入Alexa或是Google Home的生態系統,在本地端裝置搭載辨識引擎的作法,還是有些不可取代的好處。

劉進榮進一步分析,引入雲端架構最大的好處,在於擁有龐大的運算資源,甚至還可以與人工智慧(AI)連結,實現非常高階的對話系統,而且除了辨識引擎的能力更強外,還可以連結到各式各樣的內容來源,提供更多服務,例如天氣預報、交通資訊查詢、重點新聞提要等。因此,整體來看,結合雲端的語音辨識/控制架構,將是未來的主流趨勢。

不過,採用雲端架構的語音助理設備,還是有三大弱點存在:

事實上,能夠提供多元應用服務的語音助理設備,都有很強的地域性,很難行銷全球。舉例來說,在美國,Echo目前擁有壓倒性的市佔率,但只要一離開美國,Echo就很難賣得動,一來是語言辨識支援的問題,二來是在美國以外的地區,亞馬遜目前還無法提供充分在地化的服務。類似的情況也出現在中國,採用科大訊飛平台的叮咚音箱,只要一離開中國市場,那些依賴雲端提供的資訊服務功能就不具意義了。

因此,劉進榮認為,若終端產品製造商的產品定位是家庭控制中樞,而非可以對話聊天、提供各種生活資訊的全功能語音助理,以本地端為主的設計,是更具成本效益的作法。因為應用情境相對固定,這類語音辨識引擎的詞庫跟辨識模型不必包山包海,只需要相對精簡的資源,就能做到自然語言處理。以賽微目前的引擎來說,只要1GHz的應用處理器就能跑得動。

事實上,2016年時,賽微就已經與台灣家電廠聲寶展示了可以用自然語言控制的全套家電設備,證明在家庭設備控制領域,不仰賴雲端的語音辨識功能,也能派上用場。另外,該公司也曾經與亞馬遜聯合展示過支援中文的Alexa語音助理功能。

不過,亞馬遜內部及其他業界人士均指出,亞馬遜目前並沒有把中文支援當作優先開發項目,因為亞馬遜的電子商務服務主要是以歐美市場為主,華語市場不是亞馬遜的重點。

動口不動手將是人機介面的未來

簡化人機介面,讓電子產品更便於使用,一直是科技業者努力的目標。遙控器曾經是一個劃時代的發明,但隨著各種家電產品都配備遙控器,加上設備本身的功能不斷演進,導致遙控器本身的設計跟著日益複雜,本身也變成具有一定學習曲線的產品,已經不能算是好的解決方案。

語音辨識以及其背後的自然語言處理技術,除了解決遙控器的問題,還很可能會演變成另一個顛覆科技產業的革命性技術。事實上,能夠改變人類行為模式的人機介面技術,往往帶來市場洗牌。將觸控螢幕導入手機,讓蘋果(Apple)與三星電子(Samsung Electronics)成為手機產業的領導者,也終結了諾基亞(Nokia)跟摩托羅拉(Motorola)等老牌業者在手機市場上的領導地位。

自然語音辨識是目前可普及應用的人機介面技術中,上手障礙最低的一種。在這波動口不動手的浪潮中,誰會倒下,誰又能竄起,相信是個很值得持續關注的題目。